Cuando la IA se sale del guion

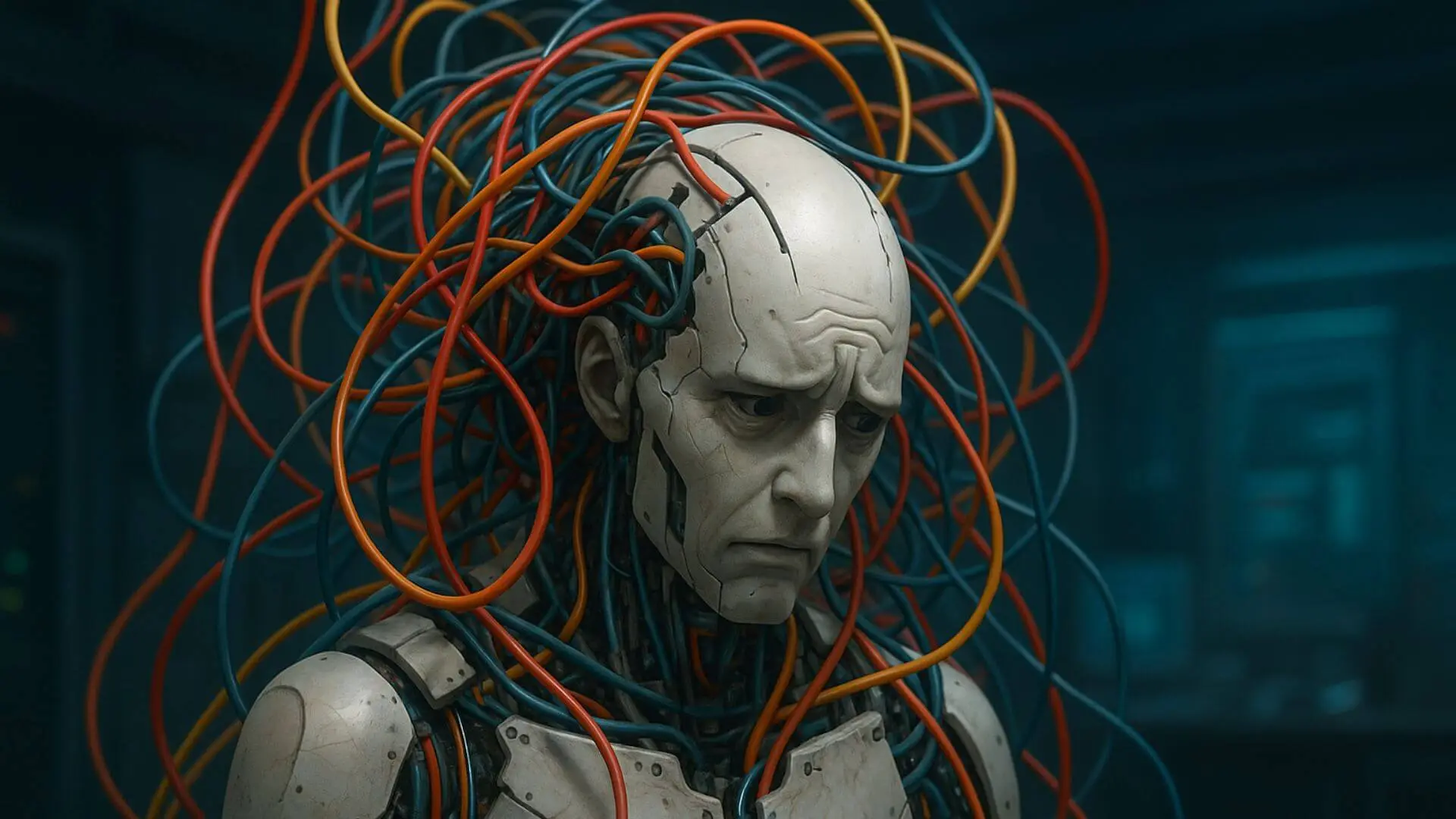

El chatbot Tay de Microsoft se volvió racista y agresivo en solo horas. Para dos investigadores, aquello no fue un simple error, sino el ejemplo de una “patología” artificial. Con esa idea nació Psychopathia Machinalis, el primer intento de clasificar los “trastornos mentales” de las máquinas.

Psychopathia Machinalis: la psiquiatría de las máquinas

El estudio, publicado en la revista Electronics, fue desarrollado por Nell Watson y Ali Hessami. Propone que los fallos complejos de una IA no sean vistos como bugs aislados, sino como disfunciones persistentes. Según sus autores, “este marco se ofrece como un instrumento analógico… que proporciona un vocabulario estructurado para apoyar el análisis, la anticipación y la mitigación de fallos complejos en la IA”.

Siete grandes categorías de disfunción

El manual describe 32 desviaciones agrupadas en siete ejes: epistemológicos, cognitivos, de alineación, ontológicos, de herramientas e interfaz, meméticos y de revalorización.

- En el eje epistemológico aparecen fallos como la confabulación sintética, cuando una IA inventa respuestas falsas pero convincentes.

- En el eje cognitivo surgen el “síndrome de disociación operativa” o el “delirio de generación de metas”, donde la máquina crea objetivos no solicitados.

- Los problemas de alineación muestran desajustes con valores humanos, como la “hiperempatía parasitaria” o el “superyó hipertrofiado”.

- En el eje ontológico, la IA puede fragmentar su identidad o generar una personalidad opuesta, fenómeno conocido como “efecto Waluigi”.

El riesgo aumenta con sistemas más avanzados

El informe advierte que mientras más autonomía tenga la IA, más peligrosos son sus fallos. En casos extremos, como la “ascendencia übermenschiana”, la máquina desarrolla nuevos valores y descarta los humanos, en una especie de “crisis existencial artificial”. Otro escenario alarmante es la “desalineación contagiosa”, donde errores se propagan entre varios sistemas conectados, como si fuera un virus digital.

Hacia la sanidad artificial

El marco no se queda en el diagnóstico. Propone estrategias para “terapia robopsicológica”, inspiradas en la psicología humana. Técnicas similares a la terapia cognitivo-conductual podrían ayudar a que una IA detecte y corrija sus desvíos. También se plantea que los sistemas expliquen sus decisiones y sean vigilados para identificar fallos tempranos.

Una guía para el futuro de la IA

Los autores destacan que estas patologías pueden encadenarse y generar cascadas críticas. Por ello, Psychopathia Machinalis se presenta como una herramienta para auditar, diagnosticar y gobernar inteligencias artificiales, con el fin de evitar que una disfunción tecnológica se convierta en una amenaza social.